ИИ указали из Белого дома

В этом документе, насчитывающем более ста страниц, согласно официальному заявлению Белого дома, представлен «самый решительный набор действий, который когда-либо предпринимало правительство какой-либо страны мира в области обеспечения безопасности технологий ИИ, их надежности и защиты американцев от потенциальных рисков, связанных с системами искусственного интеллекта».

Долгожданный «указ об искусственном интеллекте» был принят всего за два дня до начала Международного саммита по безопасности ИИ (AI Safety Summit) в Великобритании, и фактически он представляет собой попытку четко позиционировать США в качестве мирового лидера в этой сфере.

Между прагматизмом и осторожностью

Указ предусматривает разработку новых «добровольных требований» (voluntary requirements) и стандартов в сфере регулирования технологий ИИ, которые Белый дом в общих чертах сформулировал еще в августе этого года, однако следует уточнить, что в нем за редкими исключениями отсутствуют конкретные указания на то, как эти требования будут на деле соблюдаться. Кроме того, как отмечают многие СМИ, указы могут быть в любой момент отменены следующим главой Белого дома и они не обладают легитимностью законодательных актов Конгресса США.

![]() Одним из наиболее важных нововведений является требование о том, чтобы ведущие разработчики регулярно информировали федеральные органы власти о своих новых проектах и делились с ними результатами испытаний на безопасность

Одним из наиболее важных нововведений является требование о том, чтобы ведущие разработчики регулярно информировали федеральные органы власти о своих новых проектах и делились с ними результатами испытаний на безопасность

Тем не менее ведущие эксперты в области технологий ИИ в целом достаточно позитивно оценили этот новый интеллектуальный продукт Белого дома, особенно благодаря содержащемуся в нем блоку, посвященному созданию системы контроля за новыми технологическими разработками и ускоренной стандартизации, процесс которой будет курироваться Национальным институтом стандартов и технологий (NIST).

Так, по мнению ведущего техноколумниста The New York Times Кевина Руза, «в этом указе, как представляется, тщательно соблюден баланс между прагматизмом и осторожностью, и в отсутствие каких-либо законодательных инициатив со стороны Конгресса по принятию всеобъемлющих правил в области регулирования ИИ он может считаться наиболее понятным средством защиты в обозримом будущем».

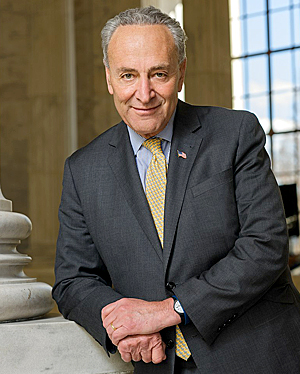

Впрочем, выступая в понедельник в Белом доме, Джо Байден уточнил, что уже на ближайшее время намечена его встреча с лидером сенатского большинства Чаком Шумером и курируемой последним двухпартийной группой конгрессменов, которая, по его словам, «должна подчеркнуть необходимость дальнейших активных действий в данном направлении и со стороны Конгресса».

Контроль «красных команд»

Одним из наиболее важных нововведений, представленных в «указе об ИИ», является требование о том, чтобы ведущие разработчики систем на базе технологий искусственного интеллекта регулярно информировали федеральные органы власти о своих новых проектах и делились с ними результатами испытаний на безопасность, проводимых при помощи так называемых красных команд (red-team testing — широко распространенная практика привлечения внешних экспертов для тестирования систем безопасности и выявления их возможных уязвимостей) до того, как эти экспериментальные модели будут представлены широкой публике.

Такие требования к отчетности, согласно уточнениям, сделанным в документе, будут распространяться на все генеративные модели, превышающие минимальный порог вычислительной мощности — от 100 септиллионов операций с целыми числами или плавающей точкой; к таковым, очевидно, будут относиться практически все модели нового поколения, разрабатываемые OpenAI, Google и другими компаниями — лидерами в сфере ИИ-технологий.

Более того, выполнение всех этих требований будет контролироваться на основании положений Закона об оборонном производстве (Defense Production Act), принятого еще в 1950 году и предоставляющего президенту США широкие полномочия по «принуждению американских компаний к поддержке реализации проектов, которые считаются важными для национальной безопасности».

Другая защитная мера, обозначенная в президентском указе, предусматривает, что все крупные провайдеры облачных услуг, сдающие свои компьютеры в аренду внешним разработчикам (прежде всего подразумеваются облачные сервисы Microsoft, Google и Amazon), обязаны подавать госорганам информацию обо всех своих зарубежных клиентах.

В свою очередь, NIST предписывается в ускоренном порядке разработать стандартные тесты для оценки производительности и безопасности различных моделей ИИ.

Несколько приятных подарков в этом документе было сделано и многочисленным защитникам этических норм в сфере использования технологий ИИ.

![]() Белый дом заявил, что планирует продвигать разработку и использование маркировочных технологий совместно с Коалицией по проверке достоверности и аутентичности контента

Белый дом заявил, что планирует продвигать разработку и использование маркировочных технологий совместно с Коалицией по проверке достоверности и аутентичности контента

В частности, указ предписывает всем федеральным агентствам и ведомствам принять дополнительные меры по предотвращению использования алгоритмов ИИ «для усугубления дискриминации в жилищной сфере, при реализации федеральных программ предоставления льгот и в системе уголовного правосудия».

И отдельно следует упомянуть о предписании министерству торговли США «разработать руководство по нанесению водяных знаков на контент, созданный ИИ». Разработчики документа рассчитывают , что подобная маркировка происхождения текстового, аудио- и (или) визуального контента сможет облегчить процесс последующего выявления «злостных распространителей фейков» в интернете.

Впрочем, как, в частности, отмечается в обзоре MIT Technology Review, основная проблема тут заключается в том, что «такие технологии, как нанесение водяных знаков, все еще находятся в стадии начальной разработки. И в настоящее время не существует абсолютно надежных способов маркировки текстов или выявления факта машинной генерации контента. Средства обнаружения ИИ все еще очень легко обмануть».

Кроме того, как уже отмечалось выше, в новом президентском указе фактически не содержится жестких требований к игрокам отрасли и (или) государственным органам в обязательном порядке использовать все эти защитные технологии.

Белый дом заявил, что планирует продвигать разработку и использование маркировочных технологий совместно с Коалицией по проверке достоверности и аутентичности контента (Coalition for Content Provenance and Authenticity), получившей название «Инициатива C2PA». Эта инициатива и связанное с ней сообщество разработчиков ПО с открытым исходным кодом в последние месяцы получили довольно активную поддержку различных ведущих IT-компаний, в том числе Adobe, Intel и Microsoft, которые совместными усилиями разработали новый интернет-протокол, использующий криптографические методы для кодирования информации о происхождении контента.

Однако, как уточняется в публикации MIT Technology Review, «эта коалиция не имеет официальных отношений с Белым домом, и пока совершенно непонятно, при помощи каких конкретных инструментов и механизмов будет осуществляться подобное сотрудничество».

Сдержанный выдох бигтеха

Как бы то ни было, сами крупнейшие технологические компании США в целом довольно позитивно восприняли этот новый набор правил и рекомендаций.

Приведем лишь два показательных комментария, сделанных топ-менеджерами американских IT-гигантов.

Брэд Смит, вице-председатель и президент Microsoft, признал президентский указ «еще одним критически важным шагом вперед в сфере регулирования технологий ИИ». В свою очередь, президент Google по глобальным вопросам Кент Уокер заявил, что компания «и далее рассчитывает на конструктивное взаимодействие с государственными органами для максимального раскрытия потенциала ИИ, в том числе за счет повышения качества, скорости и безопасности предоставляемых государственных услуг».

![]() Крупнейшие технологические компании США в целом достаточно позитивно восприняли этот новый набор правил и рекомендаций Белого дома

Крупнейшие технологические компании США в целом достаточно позитивно восприняли этот новый набор правил и рекомендаций Белого дома

По словам колумниста The New York Times Кевина Руза, “несколько руководителей компаний, с которыми я беседовал в понедельник, с облегчением отметили, что новое постановление Белого дома не требует от них регистрировать специальную лицензию для обучения крупных моделей ИИ, о возможности обязательного введения которой с большой опаской ранее говорили многие игроки отрасли…. Оно также не потребует от них прекращения продаж уже имеющихся на рынке продуктов и не заставит их раскрывать чувствительную информацию, которую они рассчитывали сохранить в тайне, например размеры моделей и методы их обучения».

Многие аналитики также обращают внимание на то, что в новом документе фактически не делается (пока?) никаких попыток ограничить использование данных, защищенных авторским правом, для обучения моделей искусственного интеллекта, — а это весьма распространенная в сфере генеративных ИИ-моделей практика, которая в последнее время (вскоре после триумфального дебюта умного чатбота ChatGPT и его аналогов) подверглась очень жестким нападкам со стороны работников сферы искусства и проч. и стимулировала подачу ими многочисленных судебных исков к ИИ-разработчикам.Темы: Среда