Реальный ИИ для реального мира

Официальное сообщение об успешном закрытии первого раунда финансирования AMI Labs было опубликовано во вторник 10 марта. По информации ряда СМИ, еще в декабре прошлого года эта французская лаборатория ИИ планировала привлечь на начальном этапе 500 млн евро, но в итоге собрала 890 млн (1,03 млрд долларов по текущему курсу), что уже конвертировалось в предварительную оценку ее стоимости в 3,5 млрд долларов.

Показательно также, что сам этот стартап фактически вышел из «стелс-режима» менее чем за два месяца до получения солидной финансовой поддержки, в январе 2026 года. «AMI Labs будет продвигать исследования в области искусственного интеллекта и разрабатывать приложения, в которых действительно важны надежность, управляемость и безопасность, прежде всего для управления промышленными процессами, автоматизации, носимых устройств, робототехники, здравоохранения и других ключевых областей… Мы уверены, что настоящий интеллект не начинается с языка (то есть c использования больших языковых моделей, LLMs. — “Стимул”). Он начинается в реальном мире», — говорится в заявлении о миссии компании, размещенном на ее интернет-сайте.

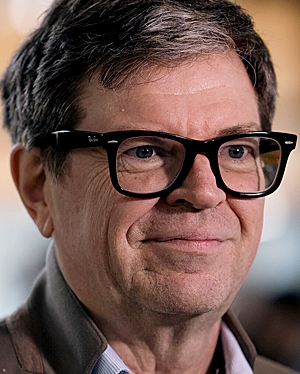

Ведущий соучредитель и исполнительный председатель AMI Labs, — один из ведущих мировых авторитетов в ИИ-отрасли Ян Лекун — объявил о своем окончательном уходе из компании Meta (в России признана экстремистской организацией и запрещена) в ноябре прошлого года.

Второй ключевой фигурой в AMI Labs и ее генеральным директором является Александр Лебрюн — еще один ветеран ИИ-индустрии, который ранее весьма удачно продал свой ИИ-стартап Wit.ai Facebook (социальная сеть принадлежит Meta и заблокирована в России), после чего работал рука об руку с Яном Лекуном в FAIR (Facebook AI Research, автономное исследовательское подразделение империи Марка Цукерберга), а позже запустил новый успешный ИИ-стартап Nabla.

И именно Nabla, которая разрабатывает ИИ-помощников для клинической медицинской помощи, фактически была одной из главных движущих сил, приведших в итоге к созданию нового стартапа AMI Labs (Лебрюн был ее исполнительным директором, а Лекун подрабатывал в ней консультантом).

Список реальных инвесторов AMI Labs весьма обширен и красноречив. В частности, известно, что в финансировании компании приняли участие как солидные европейские игроки (прежде всего «французского розлива», в том числе фонды Cathay Innovation и Hiro Capital, группы Dassault и Mulliez, а также основатель Free миллиардер Ксавье Ниль), а также американские инвесторы (фонд Greycroft, «вездесущая» Nvidia и фонд Bezos Expeditions основателя Amazon Джеффа Безоса) и азиатские инвесторы (фонд автопроизводителя Toyota и гиганта электроники Samsung, а также ведущая сингапурская инвесткомпания Temasek Holdings).

Согласно первым заявлениям Александра Лебрюна, на начальном этапе при формировании команды AMI Labs компания намерена «отдавать приоритет качеству над количеством» (пока в компании работает всего 12 человек). Ее персонал будет рассредоточен по четырем ключевым локациям: Париж, где находится штаб-квартира; Нью-Йорке (Ян Лекун преподает в Нью-Йоркском университете); Монреаль, где работает еще один инициатор создания компании Майкл Раббат; и Сингапур, который рассматривается в качестве важнейшей базы для активного привлечения азиатских талантов в области ИИ, а также, разумеется, в качестве будущего ключевого рыночного форпоста.

ИИ для реальной экономики

В целом столь удачный стартовый рывок AMI Labs стал еще одним подтверждением наметившейся тенденции: многие серьезные инвесторы приходят к пониманию, что текущая парадигма ИИ, базирующаяся на LLMs (ChatGPT и его многочисленные аналоги и варианты), практически уперлась в потолок своих возможностей, и делают ставку на следующую возможную ступень эволюции ИИ — так называемые мировые модели (World Models), основанные на принципиально иной архитектуре ИИ.

Так, по давнему убеждению Яна Лекуна, одного из пионеров технологии генеративного искусственного интеллекта и разработки больших языковых моделей, ИИ-системы на их базе не смогут привести к созданию «по-настоящему интеллектуальных машин». По его мнению, главная проблема LLMs в том, что они не могут осуществлять перспективное планирование и, будучи обучаемы исключительно на цифровых данных, неспособны понять все сложности и проблемы реального мира.

Создатели AMI Labs обещают, что их ИИ системы будут не только понимать «реальный мир», но и обладать постоянной памятью, способностью рассуждать и планировать будущее, а также будут полностью управляемыми и безопасными.

Основной подход, главным адептом которого выступает Ян Лекун, заключается в разработке новой программной архитектуры Joint Embedding Predictive Architecture (JEPA).

![]() Главная проблема LLM в том, что они не могут осуществлять перспективное планирование и, будучи обучаемы исключительно на цифровых данных, не способны понять все сложности и проблемы реального мира

Главная проблема LLM в том, что они не могут осуществлять перспективное планирование и, будучи обучаемы исключительно на цифровых данных, не способны понять все сложности и проблемы реального мира

Мировые модели на базе JEPA (или других схожих по идее архитектур) должны обучаться не на текстовых массивах, а на всем разнообразии «внешней информации», то есть на видео- и сенсорных данных, данных о различных физических взаимодействиях и процессах.

Иными словами, главная задача «мировых моделей» — корректное предсказание «следующего состояния реальности» или фактический переход от «ИИ-лингвиста» к «ИИ-физику/инженеру».

В частности, идеологи AMI Labs рассчитывают в будущем лицензировать свою технологию различным промышленным партнерам для ее возможного применения и обкатки в реальных условиях.

Так, по словам Лебрюна, «мы разрабатываем модели, которые помогают понять мир, а это невозможно сделать, запершись в лаборатории. В какой-то момент нам нужно будет применять модели в реальных условиях с реальными данными и реальными оценками».

И та же компания Nabla, которая стояла у истоков создания AMI Labs, — первый из ее уже известных партнеров, который рассчитывает получить доступ к этим ранним моделям.

Следует также отметить, что создатели AMI Labs изначально ориентируются на открытость своих разработок и заявляют о готовности представить значительные объемы в виде открытого исходного кода для последующего формирования вокруг компании обширной исследовательской экосистемы.

Акцент на «умной абстракции»

В основе концепции JEPA лежит стремление к максимальному приближению ИИ к базовым механизмам работы человеческого мозга. В частности, это означает умение прибегать к корректным «умным абстракциям», то есть к игнорированию на макроуровне ненужной (излишней) информации.

Самый простой пример: человек переходит дорогу и видит несущийся на него грузовик. Человеческий мозг (разумеется, в меру своих возможностей) тут же примерно оценивает его скорость, массу и траекторию движения. При этом ему совершенно не нужно одновременно внимательно изучать, как выглядит водитель грузовика или что именно написано на рекламном щите, который установлен рядом на дороге.

Если же заставить нынешний ИИ (типичные LLM-модели) просчитать все детали подобной сцены, он просто «захлебнется» в обильных вычислениях всех привходящих факторов и может упустить главное — сам факт возможного фатального столкновения с грузовиком.

Использование же JEPA позволяет быстро отбросить внешность водителя и прочий визуальный шум, чтобы сразу же точно просчитать массу, направление возможного удара грузовика и сделать выводы о грозящей человеку опасности.

Иными словами, ИИ-модель на базе JEPA принимает во внимание «прочие детали» только тогда, когда они, по ее оценкам, критически важны для последующего конкретного действия.

![]() Использование JEPA позволяет быстро отбросить внешность водителя и прочий визуальный шум, чтобы сразу же точно просчитать массу и направление возможного удара грузовика и, соответственно, сделать важные выводы о грозящей человеку опасности

Использование JEPA позволяет быстро отбросить внешность водителя и прочий визуальный шум, чтобы сразу же точно просчитать массу и направление возможного удара грузовика и, соответственно, сделать важные выводы о грозящей человеку опасности

При этом она может, например, дать общее предсказание: «в случае игнорирования опасности человек рискует быть задавленным / отброшенным на обочину» и т. п., но «точный расчет последствий такого столкновения невозможен из-за обилия неизвестных факторов».

Соответственно, в идеале использование JEPA позволит обучать ИИ законам физики в сотни раз быстрее и дешевле (нужно меньше серверов, электроэнергии и пр.) и без различных ИИ-галлюцинаций, столь свойственных современным нейросетям (которые в случае, если чего-то не знают или не могут оценить, просто начинают фантазировать).

Впрочем, у такого базового подхода к разработке ИИ-моделей есть и очевидные минусы. Так, в сложных физических или химических системах любая, казалось бы, «микроскопическая» деталь может изменить весь исход оцениваемого события/ситуации (пресловутый эффект бабочки).

В случае с нашим базовым условным примером таким недоучтенным фактором может быть слишком скользкая дорога, сильный блик от рекламного щита, степень алкогольного опьянения пешехода, водителя и т. д. Но даже они в данном случае не отменяют ключевого вывода о грозящей человеку большой опасности.

И в целом ряде практических сфер применения этот общий подход уже в самом скором времени может принести реальные плоды. Одни из первоочередных его интересантов — огромные рынки автономных транспортных агентов и робототехники.

Другое дело применение данного подхода (за счет отбрасывания «лишних» исходных данных), например, в точном анализе физических, химических или биологических процессов, то есть там, где «детализация» критична.

Кратко же резюмируя, можно сказать, что новая гонка за «мировыми моделями» ИИ, в которую большой бизнес уже с готовностью инвестирует (а помимо AMI Labs в ней участвуют и другие стартапы, в частности World Labs и Thinking Machines Lab, созданные выходцами из OpenAI, которые также привлекли миллиардные инвестиции), — это, по сути, начало активного поиска будущего идеального баланса, надежда на то, что на базе более продвинутых ИИ-технологий удастся «оцифровать сам здравый смысл», добиться от ИИ проявлений «макроинтуиции», не потеряв при этом вместе с визуальным и прочим шумом полезную информацию.

И тот факт, что в AMI Labs и в его конкурентов уже вложены миллиарды долларов, — это четкий сигнал о том, что инвесторы почти готовы признать: научить ИИ «выделять главное» в практической плоскости куда важнее, чем заставить его с фотографической точностью рисовать детали по исходному макету, как это уже успешно научились делать современные продвинутые нейросети.

Темы: Инновации